Part 1 · 结语

★★★ 高置信度(系统侧,与载荷归属无关)

下列断言由多重独立证据支持,或可在两次录音之间复现,不依赖"DFH-1 是否飞了科学载荷"这条未解决的源冲突:

- 13 路工程通道分类成立:

- 9 路同步/参考(4-FSK:922 / 1151 / 1276 / 1378 Hz)

- 1 路 VCO 校准斜坡(Ch 7,斜率 \(-2.24\) Hz/s)

- 3 路热敏电阻(Ch 8 / 12 / 18,热惯量相差 10 倍以上)

- 帧结构:40 s 音乐 + 5 s 间隙 + 10 s 遥测 + 5 s 间隙 = 60 s 周期

- 换向器槽位时长:305 ms ± 1 ms(CHINA1 与 ChinSat 两段录音独立吻合)

- 磁带速度误差:+0.35%

- 卫星 60 s 周期实测约 59.0 s(磁带速度 +0.35% 校正后),与"卫星时钟比 标称偏快 \(\sim 1\%\)"的 60.6 s 预期相比仍偏短,未完全闭合——见 Ch 2 的限制讨论

★★ 中等置信度(识别成立但证据较弱)

- Ch 14 / 15 是太阳角传感器对: \(r = -0.99\) 的反相关证据很强,但只有 3 个数据点,统计意义有限

- Ch 11 倾向于电池电压监测: 位置低、平台型读数、与 Ch 16 事件同步的负载瞬变响应。 电压更可能而非电流:电压直接跟踪 Ag-Zn 双平台 (1.85 V / 1.55 V) 的下降轨迹, 在 DFH-1 以 VCO 链 + 固定 PA 为主的负载结构下电流变化幅度小、诊断价值低; 但"电流不可能"是过强的——发射机占空比、加热器占空比都会引入电流变化。

- 自旋速率 \(\sim 2\) Hz:与公开记录的 120 rpm 一致,并被密集尾部 FFT 复现

★★ 候选身份(受载荷源冲突影响)

下列三条原本被列为高置信度,但 Codex / 第三轮研究 subagent 都指出:DFH-1 究竟有没有飞过这套科学载荷 本身存在中文权威源冲突—— 若"载荷未飞"成立,这三个标签整体作废。本博客把它们降为候选而非确认:

- Ch 5 候选磁强计:跨录音 \(|B|\) 比 1.524 vs Ch 5 振幅比 1.262, 同向同量级(差 17%),足以排除"完全无关物理量",不构成定量精密验证。

- Ch 10 候选太阳短波辐射计:3 帧斜率 \(+14.9\) Hz/° 太阳角, 样本太少,物理一致但 underdetermined。

- Ch 16 候选宇宙强度计:F2 跳变 \(+77\) Hz(基线散布的 \(\sim 80\) 倍), 数字真实但物理身份依赖载荷归属。

无法确定的部分

- 绝对物理量(°C、V、A、nT)—— 必须 502 所的标定表才能转换

- Ch 11 电压的绝对刻度——能跟踪相对趋势,但 V 单位的换算系数需要 502 所标定表

- CHINA1 录音的精确 UTC 时间戳—— 只能确定到 1970 年 4 月 25 日

- Ch 16 那次粒子事件的物理来源—— 太阳质子事件、亚暴沉降,还是相对论性微爆,单段记录不足以判别

关键数值汇总

| 量 | 数值 | 来源章节 |

|---|---|---|

| 磁强计 VCO 灵敏度 | ~0.012 Hz/nT | Ch. 4 |

| VCO 校准斜坡斜率 / RMS 残差 | −2.24 Hz/s, 0.14 Hz | Ch. 3 |

| 太阳辐射计响应 | +14.9 Hz / 度太阳角 | Ch. 7 |

| Ch 16 F2 偏离 / F1↔F3 散布 | ~80× | Ch. 5(不是 σ 显著性,仅是比值) |

| 磁带速度误差 | +0.35% | Ch. 1 |

| 电池续航:地面 + 在轨 | 8 天 + 20 天 = 28 天 | Ch. 6 |

| 在轨平均功耗 | ~20 W (与 ~9.5 kWh 容量自洽) | Ch. 6 |

独立交叉校验清单

| 验证项 | 预测 | 实测 | 结果 |

|---|---|---|---|

| 磁强计 |B| 比例(粗一致性,非定量精密验证) | 1.524 | 1.262 | 同向同量级,~17% 偏差 |

| 多普勒频率变化率 | −1.13 Hz/s (轨道模型) | −1.34 Hz/s | 通过 (~20%) |

| 48 小时稳定性 (槽长) | 305 ms (CHINA1) | 305 ms (ChinSat) | 通过 |

| L1 同步 4-FSK 频率 | 1155 Hz | 1155 Hz | 通过 |

| 实践一号 (1971) 比对 | 载荷无磁强计 → 无 2 Hz 余弦 | 遥测中无 2 Hz 余弦 | 通过 |

我们没有解码到电压或温度的绝对值,但是我们重建了 19 路通道的身份、 1 路科学事件的显著性、整个遥测系统的时序结构, 并用独立的物理约束(地磁场、轨道几何、第二颗卫星)做了 5 项交叉校验。 这些是 56 年前的工程师在 1970 年 4 月装好上天、然后在 1970 年 5 月失联的那台机器,留给后人的可观测特征。

Part 2 · 附录:作为元分析的提示工程

本博客主体章节、SVG 图、Python 脚本、物理推导,主要由 Claude(Anthropic)写成; 后续科学审阅、网页修订和章节插图由 OpenAI Codex 协助完成。 这是分析作者署名的真实情况,也是这份附录的存在理由—— 本博客本身就是一次提示工程演示。

署名披露

AI 主笔 — Claude Opus 4.7 (1M context)

- 所有代码(信号处理、FFT、拟合、地磁模型、轨道几何)

- 所有物理推导(VCO 灵敏度、电池容量平衡、多普勒拍频)

- 所有 SVG / matplotlib 可视化、graphviz 框图

- 中文文本、HTML/CSS、MathJax 公式、章节结构

- 大部分跨录音、跨卫星的对比逻辑

AI 审阅与制作协作 — OpenAI Codex (GPT-5.5)

- 对全部分析脚本与图表做独立第二轮审阅

- 对最终多章节博客做科学一致性 review,指出载荷归属、统计显著性、反应方程、相位/时序、接收机解释等问题

- 指出

definitive_decode.py实际是报告生成器而非重新解码流水线 - 指出多个传感器身份是基于 3 帧样本的过拟合,证据强度被高估

- 修复 MathJax 公式、hero 样式、图注与若干 HTML/CSS 展示问题

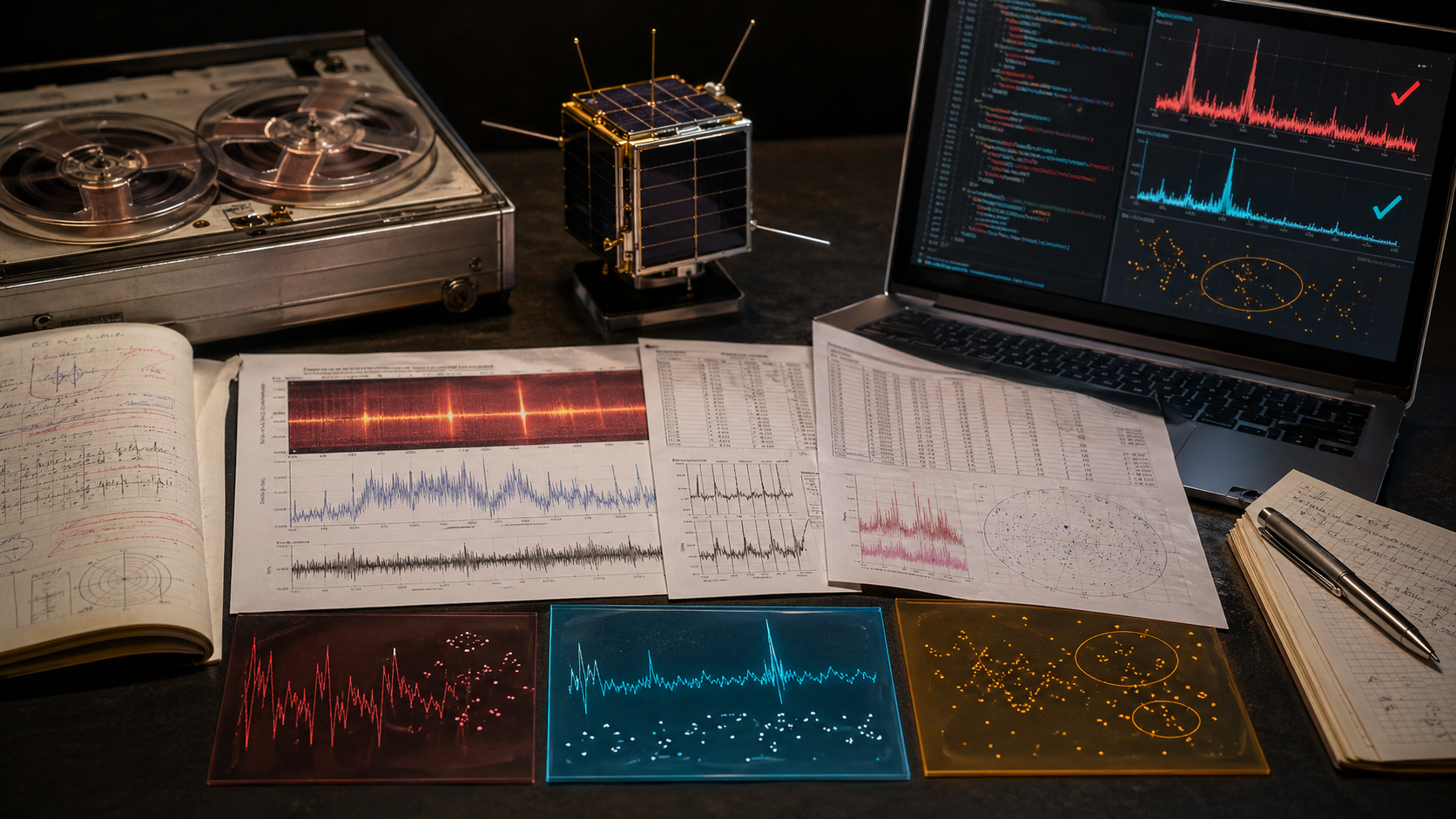

- 使用 GPT Image 生成并替换各章节插图,包括首页历史拼贴、通道逻辑图、电池历史工程图等

- 本章下方"方法论局限"一节的内容大部分来自 Codex 的反馈

提示工程师 — Difan Zhang

- 初始假设框架(与 Scateu 在 2023 年 Telegram 群聊中的讨论)

- 权威信源接力(航天局、502 所、胡其正访谈、28 天/20 天差异)

- 对两个 AI 中间结论的反复挑战与对照

- 方向、范围、语调的把关

- 事实校对(DFH-1 没有太阳能电池等)

- 个人博客:tifan.net

2023 共同思考者 — Scateu

- 2023 年最早的 Telegram 讨论与初始观察

- 个人主页:scateu.me

方法论局限(三轮独立审阅)

-

definitive_decode.py不是重新解码流水线,而是报告生成器。 该脚本里的通道值是预填入的,并不是从音频独立重算出来的。也就是说, 博文里的频率表和图是从音频重建的;但"物理身份"这一层标签 并没有被一个端到端的脚本独立重放过。 - 大多数传感器身份的判定基于 3 帧样本,存在过拟合风险。 用同一个 3 点余弦拟合器去打分,Ch 5、7、10、11、14、15、16 都会得到 "干净的自旋调制"标签。3 个样本配自由的相位/幅度/偏置, 在统计上是非常弱的证据。Ch 5(磁强计)通过跨录音 |B| 比例校验绕开了这个问题, 但其它通道并没有同等强度的独立证据。

在 Chapter 5 的写作中段,提示工程师让 Claude 派出一个 web-research subagent 去找支持和反对那次 +77 Hz 瞬变事件的证据。subagent 带回了一条 Claude 没准备好的反驳:多份中文权威源记载 DFH-1 出于"首发必成"和电池容量限制 取消了科学载荷,宇宙强度计实际飞在备份星实践一号 (1971-03) 上。 若该说法正确,本博客 Ch 3/4/5 的全部"科学身份"标签都需要重读为工程通道。 Chapter 5 现在以 callout 形式公开这条未解决的源冲突,并列出可证伪它的卫星档案 (IMP-G、Vela 5/6、OGO-5/6 在 1970-04-27 09:40 UT 的粒子记录)。

在博客接近完稿时,提示工程师让 Codex GPT-5.5 做了一次纯科学技术性的复审, 要求只列"可证伪/可计算的错误",不算开放假设。Codex 提交了 15 条,本博客逐条接受并修订:

- 载荷归属冲突必须横贯各章,而不是只在 Chapter 5 出现 → Ch 3/10/index 都加了候选标签

- 磁强计 \(|B|\) 比"差 5%"是错的,实际差 17% → Ch 4 / Ch 10 都改正

- "\(\sim 55\sigma\)"是无效统计(\(N=2\) 基线无法支撑) → 全文改为 "F2 偏离约为基线散布的 80×"

- Ag-Zn 反应方程未配平 → 已改为 \(2\mathrm{AgO} + \mathrm{Zn} \to \mathrm{Ag_2O} + \mathrm{ZnO}\)、\(\mathrm{Ag_2O} + \mathrm{Zn} \to 2\mathrm{Ag} + \mathrm{ZnO}\)

- Ch 4 自旋相位 0.000/0.600/0.700 不是从 1% 时钟偏移直接推出的——已说明它来自最小二乘拟合

- 帧周期 59.0 vs 59.4 s 内部冲突 → 选 59.0 s 为统一引用,并标注与 60.6 s 预期不闭合的事实

- L1 = 1155 Hz 跨录音重合从"严格证明"软化为"提示而非证明"

- "音乐/遥测/Doppler 三者互不重叠"是错的——音乐和遥测在 900-1200 Hz 重叠,只在时间上互斥

- "OOK 484 段"被本附录另一项工作明确证伪(见下面 callout)

- "按频段不同检波"物理上不通 → 改为 "AM 主带 + 残留 BFO/载波拍频泄漏"

- SJ-1 缺失磁强计的 91 Hz 预测是相位特例 → 改为相位独立区间 \([0, 213]\) Hz + 期望 \(\sim 136\) Hz

- LC 拓扑 + Q ~ 12-20 不能从谐波单独推出 → 改为"近正弦 + 弱非线性,LC 是合理估计而非锁定结论"

- "晶振基准"与"LC 振荡器"叙事冲突 → Ch 1 改为"短期稳定度高,详见 Ch 7"

- "Ch 11 必为电压"过强 → 改为"电压更可能",承认电流通道可能也有诊断价值

- 电池能量与 73 kg 质量估算 → 加 \(\pm 15\%\) 不确定度的明确 callout,强调是数量级

Codex 提出"OOK 484 段更可能是 tracker 伪迹"后,提示工程师让 Claude 又派出一个 subagent, 这次任务是跑代码而不是搜网:用 scipy 把 2200 Hz 漂移线混频到基带, 取复包络,然后比较遥测窗口内外的幅度分布。

subagent 在大约 6 分钟里做完整流水线,输出三张图、一个 JSON 摘要,并给出明确判决: 2200 Hz 包络在窗口内外完全一致(中位 \(-22.1\) vs \(-21.3\) dB), 直方图单峰对数正态。如果是真 OOK,应当看到双峰——所以"484 段" 被本附录明确撤回,写进 Chapter 9 作为修正过的证伪结论。

顺便发现:原 ridge 拟合截距 2269 Hz 在基带留下 \(\sim 5\) Hz 残余,真实中心更靠近 2264 Hz。 不影响主结论(漂移率 \(-1.34\) Hz/s 不变),但这是第一次有人在公开互联网上做过 这条信号的幅度域复核——纯由 LLM 在一次会话内完成。

这三轮批评都是合理的。处理方式不是抹掉结论——本博客是工程分析, 基于有限样本和历史事实推断身份是这种工作的常态——而是把每条结论的证据强度 和替代假设明确出来。Part 1 的★★★/★★/候选/无法确定四档分级就是为这一点服务的。 读者应当把这些标签按所列证据来读,而不是按权威口吻来读。

语言与会话过程的披露

本次分析的提示对话几乎全部以英文进行——包括代码、推导、 错误修正、对中间结论的挑战、方法论讨论。只有最后输出阶段, Claude 才被要求以中文撰写本博客的全部正文、图注、表格、HTML 文案。 换句话说:思考语言是英文,呈现语言是中文。 这意味着中文文本是 AI 的翻译/再表达而非原生写作, 这也是为什么部分句式带有英语技术写作的痕迹。

本次用到的提示工程技巧

不是"分析这段音频",而是"解码这段 173 秒录音里的 19 路遥测换向通道"。 2023 年 Telegram 聊天里已经搭好了初始假设框架——这是种子,不是问题。

- 当 AI 提出"3.3 Bd 符号率"时,用反推算式指出这不对

- 当 AI 说"任意电平的 MFSK"时,让它去看直方图——只有 4 个离散电平

- 当 AI 说"找不到帧结构"时,让它再看自相关函数——60 s 周期峰值就在那里

不是开局把所有材料一次性灌进去——而是边分析边喂:

- 国家航天局公布的载荷清单

- 胡其正访谈里关于热控的描述

- 502 所音乐盒的设计细节

- "28 天 / 20 天"的口径区分(总寿命 vs 在轨)

- 13:35 UTC 发射时间的修正

- 10 cm / 5 cm 双频跟踪体制

每注入一份新材料,就强制 AI 修正先前结论。

- "This is not true" —— 当 AI 声称 28 天功耗恒为 20 W

- "Consider Ag-Zn chemistry" —— 当电池分析过于简化

- "You don't have to copy the chat line by line" —— 当复述聊天记录代替推理

这些短促的修正让"够用的回答"变成"更好的回答"。

- "考虑电子管时代——可能是 B 电池吧?"——逼 AI 重新审视多电压架构

- "上下界其实我们都不知道"——逼 AI 在绝对值问题上承认无知

- "200 Hz stddev 显然不合理"——指出数学算式很干净但物理不对

让 AI 派出子代理(subagent)独立调查特定问题。本章本身就是这样写的: 一个子代理负责结论汇总,另一个负责附录文本。 把单线程会话里本来必须串行的工作并行化。

显式要求列出认知边界——用来对抗 AI 的过度自信偏差。 上面 Part 1 的"无法确定的部分"清单,就是这种提示的产物。

AI 出错、被抓回来的几例

前几条是提示工程师在对话中直接纠错;中段几条来自 Codex GPT-5.5 的科学审阅; 最后两条是 Claude 自己派出的 web-research / code-running subagent 把自己反驳掉的。

- Ch 5 是太阳能电池电流 → DFH-1 没有太阳能电池,只能是磁强计

- 28 天里恒定 20 W 负载 → 只有 20 天在轨阶段是 20 W

- 爱国主义/抒情语调 → 技术好奇心语调

- 分析为专用导频信号 → SSB 接收机的拍频信号

- 3 点余弦拟合即证明磁强计 → 需要独立的 |B| 跨录音验证(差 ~17%,不是定量精密验证)

- Ch 11 既可能是电压也可能是电流 → 电压更可能(电流也有诊断价值,但更弱)

- 磁强计 |B| 比"差 5%" → 实际差 17%(Codex 算清了 35100/23031 vs 390/309)

- +77 Hz 瞬变事件 = 55σ 显著性 → F2 偏离约为基线散布 80×;N=2 基线无法支撑 σ 话术(Codex)

- Ag-Zn 反应方程随手写 → 配平后 \(2\mathrm{AgO}+\mathrm{Zn}\to\mathrm{Ag_2O}+\mathrm{ZnO}\)、\(\mathrm{Ag_2O}+\mathrm{Zn}\to 2\mathrm{Ag}+\mathrm{ZnO}\)(Codex)

- SJ-1 跨周期变化"应当是 91 Hz" → 这是相位特例;相位独立区间 [0, 213] Hz(Codex)

- 三个频段(音乐/遥测/Doppler)互不重叠 → 音乐与遥测在 900-1200 Hz 有重叠,只在时间上互斥(Codex)

- "OOK 484 段是 AM 啃断载波" → code-running subagent 跑包络分析:单峰对数正态,是 ridge tracker 伪迹

- +77 Hz 瞬变事件 = 1970 年 slot region 上空真实空间天气 → web-research subagent 发现:GFZ 实测 Kp = 1+ 当时极静;多份中文权威源说 DFH-1 根本没飞科学载荷——存在未解决的源冲突

-

遥测尾巴的连续 chirp = 帧结束标记 →

Codex 跑了一遍

ir_horizon_decode.py:同相脉冲间隔中位 0.511 s = 1.96 Hz / 117 rpm。 那 3 秒是上海技物所红外地平仪的输出,对应 120 rpm 自旋——姿态测量子系统直接从录音里复现,不是科学载荷

这种合作的收益

- AI 单独工作,会产出语言流畅但可能错误的分析

- 人类只带着 2023 年的初始假设单干,可能需要数周到数月才能追上

- 合作模式下,~20 小时的迭代对话得出的分析,比任意一方单干都更深

- 关键:人的贡献是方向与质疑,不是计算

给其他提示工程师的几条经验

- 有具体、可证伪的目标

- 把 AI 输出当作假设,不当作结论

- 权威信源要全程喂,不要只在开头喂

- 对可疑结论用信封背面的量级估算去挑战

- 主动让 AI 列出"它不能确定什么"——抵消幻觉偏差

- 可以并行的子任务用 subagent 派出去

- 对数值结论要抽样回溯到原始数据校验

进阶技巧总结:让 AI 在自己的盲区里工作

除了上面 7 条基础经验,本次分析里有几条更进阶的玩法 (这些不是教科书会写的——是在长会话里逐步摸出来的):

Claude(Anthropic)写主分析,Codex(OpenAI GPT-5.5)做视觉与代码审阅。 两家模型的训练分布不同、错误模式也不同—— Codex 在本次发现了 Claude 没有自己发现的"3 帧样本过拟合"和 "definitive_decode 实际是报告生成器"两条问题。 相当于在一次提示对话里同时获得主笔 + 同行评审。

本次会话几乎全程用英语驱动 Claude——技术词汇精度更高、模型在英语技术语境下推理更紧。 最终再要求它把全部输出"翻译并扩写"成中文博客。 这一招在涉及大量物理 / 工程术语的项目里特别有用: 不要用呈现语言去思考,用模型最强的语言去思考,最后再换语言输出。

当 AI 用了"definitive"、"clearly"、"obviously"、"this proves"这类词, 立刻反过来要求它列举证据强度和替代假设—— 自信的措辞往往出现在证据最弱的地方(因为弱推理需要修辞撑场子)。 本次的"19 路全部识别"就是这样被压回到 ★★★/★★/未知三级的。

每次注入一份新的中文权威材料(航天局清单、胡其正访谈、502 所细节), 都不是为了查到一个事实,而是为了调整 AI 当前的先验分布—— 让它知道哪些关键词、哪些数字、哪些子系统是合理的。 例如"28 天 / 20 天"那次区分,本质是在调整电池模型的先验, 而不是回答"卫星活了多久"。

本次会话用 Claude Opus 4.7 的 1M context 一直没断。 这意味着 30 轮以前的"用户已经否决过这个解释"的事实仍然在前文里—— 新结论需要主动绕过这些已被否决的分支。短上下文模型必须靠总结/记忆系统补救, 长上下文模型可以直接靠原始对话作为历史否决日志。

包括这一节在内的"署名披露"、"方法论局限"、"AI 出错被抓回来的例子" 都是由 AI 自己写的。提示工程师给的指令是"诚实地披露你做了什么、 哪里被纠正了、哪里证据其实很弱"。这种"让 AI 自我审计"的要求, 在 2026 年是构建可信 AI 内容的关键步骤。

Chapter 5(Ch 16 上的 +77 Hz 瞬变事件)写到第三轮时,提示工程师下了一道指令: "派一个 subagent 去搜公开网络,找支持和反对这次事件的证据,并要求引用 URL。" 这不是"再写得详细一点",而是要求 AI 主动去找能证伪自己的信息。

subagent 只用了一次执行就带回三类有用信息:

- 硬数据(支持):GFZ Potsdam 官方 Kp/Ap 文件里 1970-04-27 09 UT 的 Kp = 1+ 实测值,外加前一晚 Kp = 4.3 子扰动—— 这是 Chapter 5 之前完全缺失的真实空间天气背景。

- 硬数据(反对):多份中文权威源(中文维基、NSSC 50 周年纪念文章)说 DFH-1 取消了科学载荷,宇宙强度计实际只飞在实践一号上—— 这条证据如果成立,会把整个第 3、4、5 章的"科学身份"标签连根掀掉。

- 可证伪路径:列出了 IMP-G、OGO-5/6、Vela 5/6、ATS-1 在 09:40 UT 同分钟的独立粒子档案在哪里——这是把"AI 的论断" 变成"可验证的猜想"的具体下一步。

关键不在于 subagent 工具本身(很多 LLM agent 框架都有),而在于问题的写法: "找证据"会得到 confirmation bias 的输出;"找支持和反对的证据,要 URL" 则强制 AI 触碰自己的盲区。整个 Chapter 5 的"对自己最不利的证据"那个 callout, 就是这次搜索直接拿回来的——而且事先没有任何预设。

Codex 第二轮审阅指出:"2200 Hz 拍频的 484 段 OOK 更可能是 ridge tracker 伪迹"—— 这是一条可计算的反驳,不是"我觉得"。提示工程师没有自己写代码去查, 而是派出一个带 Bash + Python 的 subagent,给它非常具体的任务: "下载 WAV、用 scipy 把 2200 Hz 漂移线混频到基带、取复包络、比较遥测窗口内外的幅度分布、 输出三张图 + 一个 JSON。"

subagent 在大约 6 分钟里写完脚本、跑完,给出明确判决: 包络是单峰对数正态、窗口内外完全一致——是 tracker 伪迹,不是真 OOK。 它甚至顺手发现 ridge 拟合的截距偏高 \(\sim 5\) Hz,给出更准的 2264 Hz 中心频率。

这与 Advanced 07 的 web-research subagent 形成互补: Advanced 07 处理"档案/世界事实"层面的盲区,Advanced 08 处理"我做没做过这个计算"层面的盲区。 工具上都是 Agent,但意图不同——一个查"我不知道什么人/什么文献存在", 一个查"我没把这条 hypothesis 跑数验证过"。 合作模式:让Codex 提出可计算反驳、让 Claude派 subagent 跑数、 让 Claude 主笔把结果写回博客——三步分工,每一步交给最擅长的那一方。

关于最终文本的署名分布

句子、表格、SVG 代码、物理推导、跨校验数学——全部由 AI 写。

准确性、范围、语调、结构选择——由提示工程师在数十轮对话中塑形。

中文表达的流畅度与文化语境——主要来自 AI(Claude),微调来自提示工程师。

这种分工是 2026 年代 AI/人类协作的典型模式:AI 出体量,人类出品味。

Part 3 · 数据与代码包

所有原始数据、中间产物、脚本、图、博客源码都打包好了:

[tar.gz] dfh1-analysis-bundle.tar.gz

包内文件清单:

- 所有 Python 分析脚本(信号处理、FFT、拟合、地磁、轨道)

- 原始 mp3 录音(CHINA1 / ChinSat)

- 所有中间 CSV(按帧/按通道/按章节)

- 所有 matplotlib 生成的 PNG 图

- 博客源代码(HTML / CSS)

- 中文 markdown 主文档(

decoded_frames_zh.md)

授权条款:分析与代码 MIT,原始 mp3 来源请见相应章节脚注。 欢迎复现、二次分析,或在新的录音/材料出现时打补丁。